Chaire industrielle SAFE AI

Chaire industrielle en IA de confiance

« Apprentissage prudent et robuste pour une intelligence artificielle plus sûre (SAFE AI) ».

Présentation

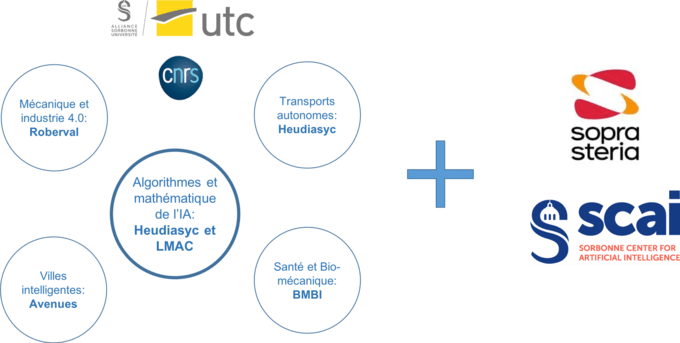

SAFE AI est un programme de recherche sur 5 ans porté par son titulaire, Sébastien Destercke (DR CNRS au laboratoire Heudiasyc de l’UTC), la Fondation UTC pour l’innovation, SOPRA STERIA, l’université de technologie de Compiègne,le CNRS et SCAI (The Sorbonne Center for Artificial Intelligence).

Thématique

La chaire est centrée sur l’IA de confiance (SAFE AI en anglais), et plus précisément l’IA sure et robuste.

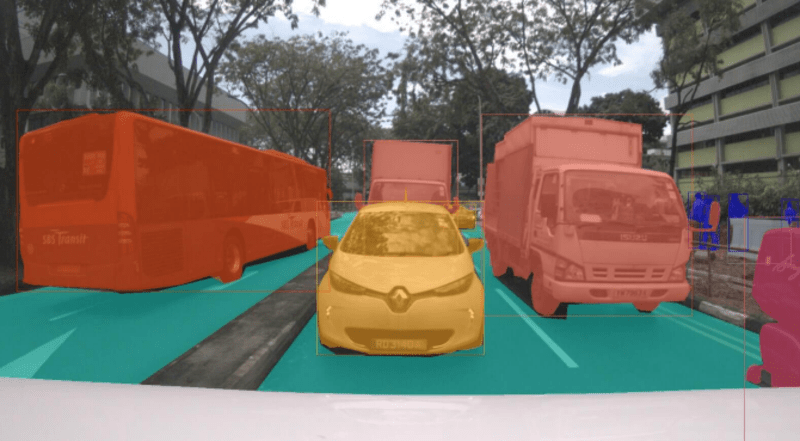

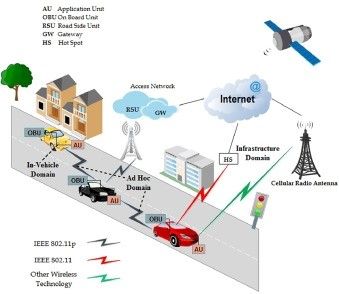

La notion d’IA de confiance regroupe plusieurs éléments : la transparence, l’éthique, l’explicabilité et enfin la sureté et la robustesse. En une phrase, l’IA sure et robuste revient à quantifier l’incertitude des prédictions, modèles et données pour garantir la fiabilité des systèmes d’IA. Celle-ci est primordiale dans beaucoup d’enjeux industriels et sociaux : détection des défauts d’usinage, des obstacles face à un transport autonome, de conditions médicales d’un patient, …

La chaire permet d’assurer un continuum entre la recherche académique et les débouchés applicatifs. Pour réaliser cet objectif, la chaire regroupe en plus du laboratoire Heudiasyc, spécialiste en raisonnement dans l’incertain et en transport autonome intelligent, et du laboratoire LMAC, spécialiste en mathématiques appliquées, trois laboratoires porteurs de champs d’application en lien avec le projet scientifique de la chaire.

Il s’agit des laboratoires Roberval, spécialisé dans la mécanique et l’industrie 4.0 ; BMBI spécialisé dans la bio-mécanique et l’e-santé ; Avenues spécialisée dans la ville intelligente et le génie urbain.

Dans le cadre du programme de la chaire, un ingénieur de recherche va être recruté, dont l’une des missions principales sera de mettre en œuvre des cas d’études pour aller jusqu’au prototypage, voire plus.

Un des indices de réussite à terme sera d’ailleurs la création d’un pôle d’ingénierie ou de start-up issues de ces travaux. In fine cela créé un écosystème bénéfique à tout le monde.

Axes de recherche

La chaire combine des actions de recherche amonts pour développer de nouveaux outils d’IA capables de répondre aux problèmes existants ou futurs que rencontreront leur application, à des actions de mise en œuvre et d’innovation sur des cas d’études.

Axe 1 : Prédictions sûres et fiables

L’enjeu de cet axe de recherche est de pouvoir prédire des prédictions dont le taux d’erreur est garanti, dans l’objectif d’augmenter la confiance dans les modèles et d’avancer vers une certification de ces derniers.

En particulier, cet axe se focalise sur les problèmes de fournir de telles garanties pour chaque individu , et non pas en moyenne, et de les produire dans des espaces de prédictions complexes (problèmes incluant une dimension temporelle, images, …).

Mots-clés

- Calibration

- Garantie statistiques

- Quantification d’incertitude

- Prédiction conformelle

- Apprentissage avec abstention

Domaines applicatifs explorés

- Industrie 4.0. (prédiction de défauts)

- Transports autonomes (reconnaissance d’obstacle)

- Villes intelligentes et énergie (prédiction de consommations futures)

- Santé (diagnostic médical)

Axe 2 : Modèles robustes

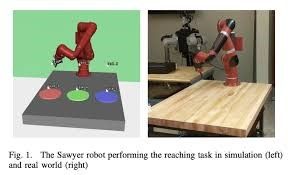

L’enjeu de cet axe de recherche est d’obtenir des modèles robustes à l’imperfection des données disponibles (« small and bad » data plutôt que « big ») ou au fait que l’environnement de déploiement diffère de l’environnement d’apprentissage du modèle, par exemple lors d’un passage de la simulation (in-silico) ou d’un environnement contrôlé (in-vitro) vers un environnement réel (in-vivo), ou encore lorsque de nouvelles classes non-présentes à l’apprentissage apparaissent.

Mots-clés :

- Apprentissage par transfert,

- Optimisation robuste

- Auto-apprentissage

- Transport optimal

- Données manquantes ou partielles

- Détection d’anomalies/nouveauté

Domaines applicatifs explorés :

- Conduite autonome et drones (simulation à commande en situation réelle)

- Santé (modèle à patient)

- Industrie 4.0. (détection de nouveau défauts)

Axe 3 : Apprentissage collaboratif

L’enjeu de cet axe est d’améliorer la qualité des modèles, soit via une collaboration modèle-modèle (par exemple des modèles s’appuyant sur différentes modalités ou mesures), soit via une collaboration modèle-humain (en sollicitant l’expert de manière pertinente et limitée).

Mots-clés :

- Co-apprentissage

- Auto-apprentissage

- Apprentissage actif

- Fusion de classifieurs

Domaines applicatifs explorés :

- E‑santé (smart home)

- Ville et transports intelligents (capteurs multiples avec possibles défaillance/absence).

Équipe

Le porteur scientifique de la chaire SAFE IA est Sébastien Destercke, chargé de recherche CNRS au laboratoire Heudiasyc de l’UTC (UMR UTC CNRS 7253).

Sa spécialité : la quantification d’incertitudes et le raisonnement dans l’incertain, notamment dans les données et l’IA. Il travaille au sein du laboratoire Heudiasyc (Heuristique et Diagnostic des Systèmes Complexes-UMR CNRS – 7253) qui opère dans le domaine des sciences de l’information et du numérique, notamment l’informatique, l’automatique, la robotique et l’intelligence artificielle.

La chaire associe également plusieurs enseignants-chercheurs des laboratoires de recherche de l’UTC :

Partenaires

SAFE AI rassemble 5 partenaires :

- Fondation UTC pour l’innovation

- SOPRA STERIA, mécène fondateur de la Fondation UTC pour l’innovation

- SCAI (The Sorbonne Center for Artificial Intelligence)

- CNRS (Centre National de la Recherche Scientifique)

- UTC (université de technologie de Compiègne)

Actualités

CONTACT

Porteur scientifique | Sébastien Destercke

Tél : 03 44 23 79 85

Mail : sebastien.destercke@hds.utc.fr